메일이 한 통 날아왔는데 많은 생각이 든다.

채용에 돈을 쓸 회사가 없어지니까 서비스도 없어지는구나 싶었다.

메일이 한 통 날아왔는데 많은 생각이 든다.

채용에 돈을 쓸 회사가 없어지니까 서비스도 없어지는구나 싶었다.

결론부터 말하자면.

AI와 로봇을 관리하고 생산하는 고숙련 노동자와 사업가를 제외한

AI데이터 학습에 필요한 데이터 마이닝을 제외한 저숙련 업종을 제외하고

전부 일자리가 대체되어가며 부익부 빈익빈의 가중심화가 일어나게된다.

더 이상 실물 노동을 하지않는 사람은 메타버스에서 노동을하지 않을까 생각한다.

현재는 그게 게임재화를 실물현금으로 판매하는 쌀먹의 형태다.

그리고 나는 VR을 좋아해서 시작하기도 했지만 XR을 2019년부터 계속 쫒아오면서 느끼는 것은.

HTC같은 중소부터 시작해서 메타,애플,삼성이 왜 근5년 넘게 실패하고있는 VR시장을 계속 놓지않는것인가에 대한 의문이었다.

시장도 작고, 불편하고 기계도 비싸서 팔리지도 않는 현재.

왜 실적도 안나는 천문학적인 적자를 감당하면서 5년째 R&D를 지속하고 새 기기를 만드는가?

사업하는 사람들은 분명 바보가 아니기 때문이라는게 내 지론이다.

분명 구글이 안드로이드시장을 독점한 것 처럼.

처음 플랫폼 깃발을 제대로 꽂은시점부터가 시작이기 때문이다.

나는 그것을 지속적으로 팔로잉하면서 꽂힌깃발 주변에 빨리 내 깃발도 꽂아버리면

최소 비트세이버처럼 되지 않을까하는 느낌이다.

유저들이 지금 나오는 VR리듬게임들이 전부 비트세이버 카피캣이라는 생각을 하듯이.

공룡이 지나간 발자국에서 생태계가 태어난다면.

공룡을 따라다니는게 맞다고 생각한다.

다음으로 AI로 대체되지 않을 대표적인 직종을 추려보자면.

노인케어, 사람을 이해하는 인문학적 예체능, 에너지 발전과 변환이다.

1. 노인케어.

저출산은 현재 우리나라가 제일 심각하지만 전세계적인 현상이다.

사람은 안태어나고 노인만 점점 늘어나고있다.

노인이되면 신체능력도 줄고, 학습하는 뇌의 능력도 떨어지기 때문에.

비상한 머리를 가지고 젊을 때 노련한 경험을 쌓아온 사람을 제외하고

평범한 사람은 생산적인 경제활동을 하기에는 정말 최악의 상태가된다.

아시아를 포함해 나이서열 문화가 분명한 한국은 더 심하고.

말 그대로 회사에서도 돈주고 고용할 필요가없는 사회적 고려장형태가 된다.

자산을쌓아둔 사람들은 어떻게든 위기의식을 가지고.

노화를 늦추려고 운동과 식단을 병행할 것이고.

그에대한 서비스를 제공하고자 하면 좋다고 생각한다.

저출산이라는것은 혼자사는사람이 늘어난다는것이고

그와중에 자산을 쌓은사람은 모르겠지만.

그냥저냥 살던 혼자사는사람은 고독사 확정이다.

그리고 몸을 가누기 힘들경우에는 화장실도 못가고 그냥 누운채로 똥싸야한다.

상상만해도 끔찍하다.

이것을 케어할 서비스도 분명 필요할것이다.

일자리도 만들고싶지만.. 같은 최저시급을 주고 젊은 인력과 노인중 골라서 써야한다는 상황을 둔다면.

아직까지 답이 안보인다.

존엄사가 법적으로 통과된다면 상황이 달라지겠다.

2. 사람을 이해하는 인문학적 예체능 컨텐츠

AI가 결과물에 대해서는 정말 높은 퀄리티 발전속도를 보여주고있지만.

AI와 대화하면서 왠지모를 현타는 밀려온다.

당장은 재밌지만 어느부분에서 어색함을 느낀순간 마지막에 결국 사람이 아니라는것을 인지한다.

노인이 되어서도 그렇고 사람과 대화하는 느낌은 대체할 수 없다.

AI가 데이터를 쌓을 수는 있어도 인생을 살며 쌓아온 경험치나 감성은 AI가 배낄 수 없다.

그 사람만 가지고있는 고유함과 그 환경과 가까이 살아온 사람들만의 공감대가 있다.

결과적으로는 인기를 끄는 감성적인 글귀나 밈은 결국은 사람이 창의적으로 만든것이 유행한다.

3. 에너지 발전

AI와 데이터센터는 결국 전기먹는 괴물이다.

그리고 각자 나라마다 전압이 다르게 표준화 되어있다.

그냥 여기서 끝났다. 더 이상 생각 안해도 될 것 같다.

그리고 인공태양기술이 하루빨리 개발되길 기도한다.

| 3년6개월 만의 블로그 복귀 재오픈 그리고 그 동안의 썰 풀기! (2) | 2022.12.25 |

|---|---|

| 개발자의 끝이 왜 치킨집인가에 대한 중도결론. (2) | 2019.05.24 |

| 구직활동에 대한 마인드셋 . (0) | 2019.05.20 |

| 자아성찰 (0) | 2019.05.03 |

| 종종 에셋스토어를 돌아다니자 (0) | 2019.05.02 |

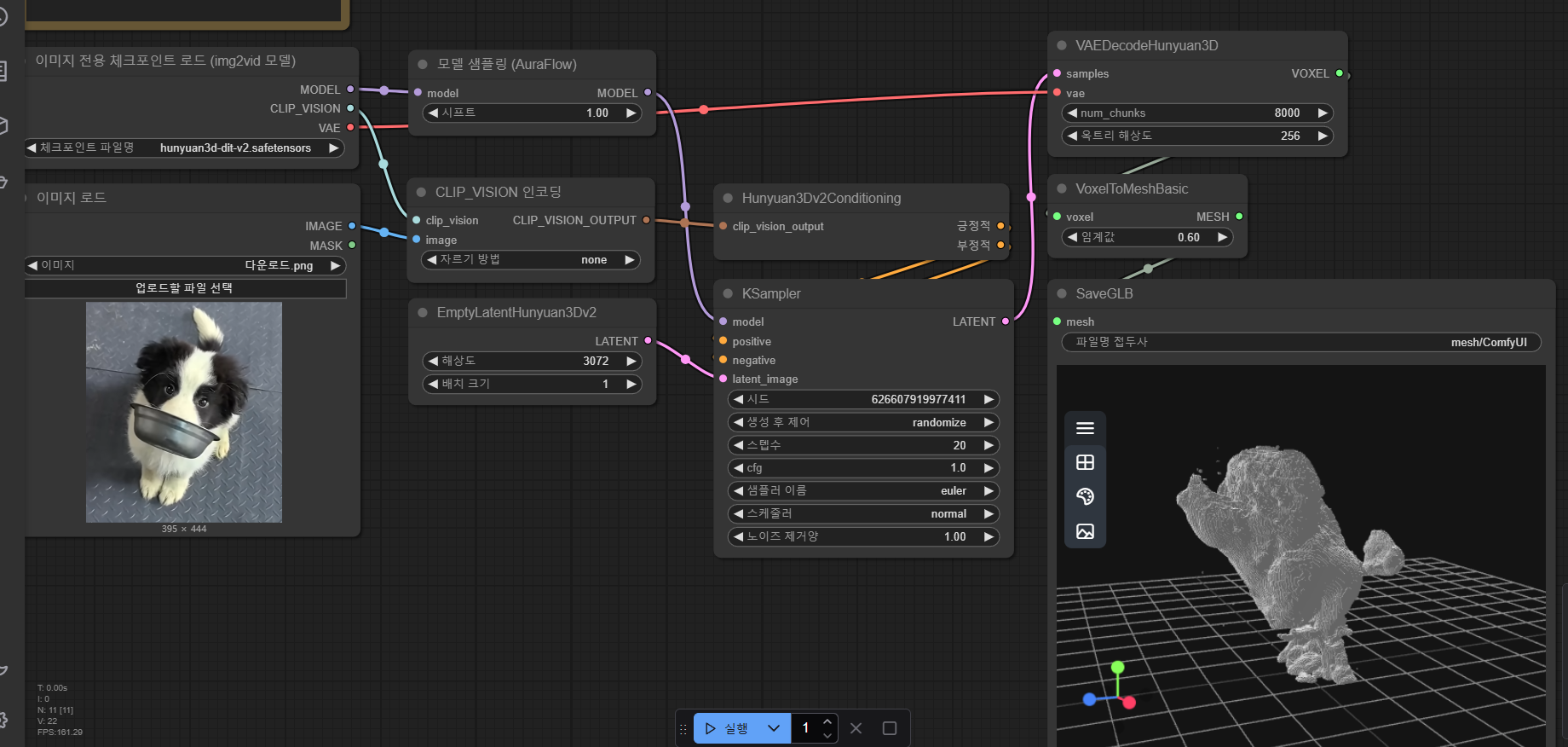

사실 유튜브보는데 유튜브에서는 메쉬를 생성하는데만 프롬프팅을하길래.

이렇게 쓰면 되지않을까? 싶어서 해봤다.

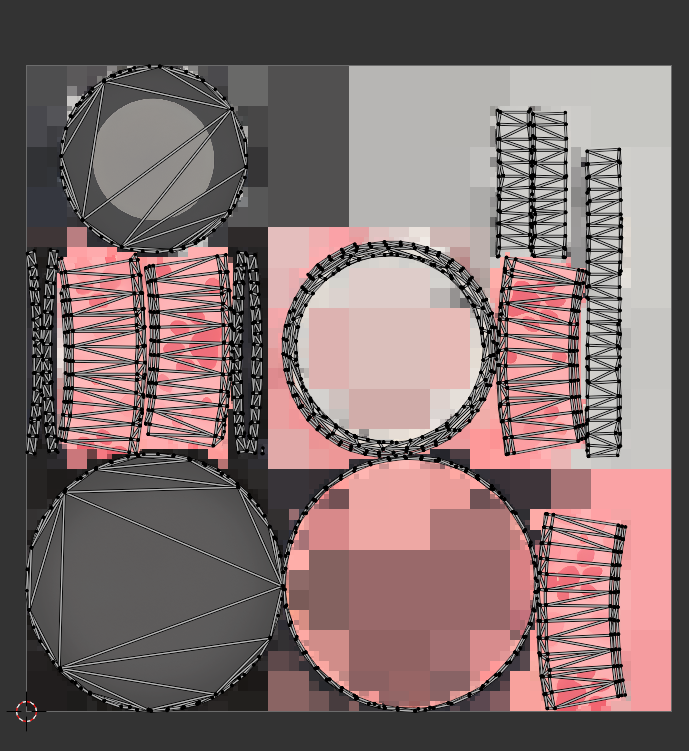

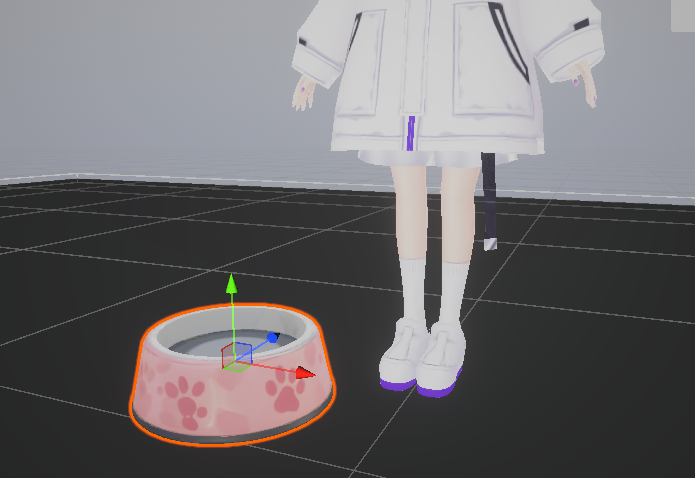

AI로 생성한 3D 오브젝트로 개밥그릇을 만들었는데 폴리곤이 너무 많아서.

모델링 할 줄 모르는 나는 MCP를 사용해보았다.

딸깍.

원본의 상태

결과는 아래처럼되고 UV도 유지된다.

유니티에서 로드하고 머티리얼까지 적용한결과다.

리토폴로지를 해야하는 모델러의 일이 줄었다. 일자리가 줄겠지ㅠ

클로드는 신이야. MCP도 그렇고 이젠 진짜 콘텐츠 창의력 싸움이다.

| 3월에 나온 ComfyUI + hunyuan3D-2 모델 사용해서 뽑아보기 (1) | 2025.03.28 |

|---|---|

| AI를 활용한 딸깍으로 슬라임 3D모델링 만들기. (0) | 2025.03.27 |

| 기술문서도 이제는 ai가 다 짜준다! (0) | 2025.03.17 |

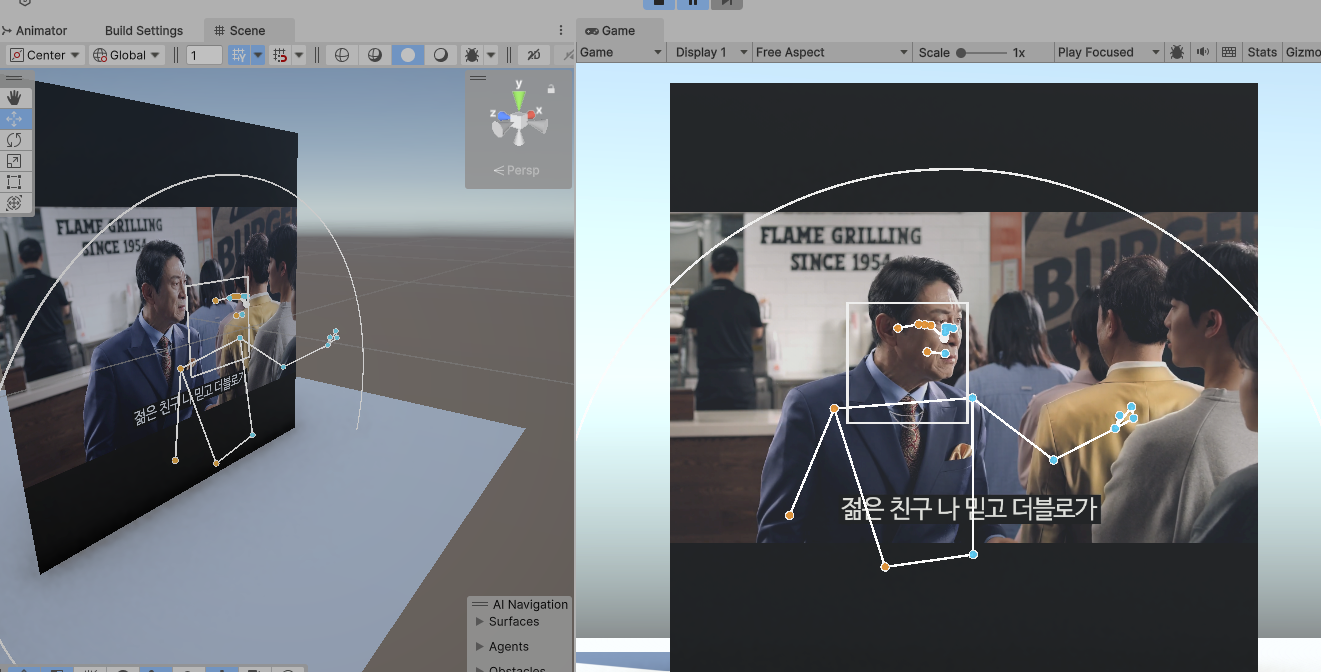

이번에 풀린 메타퀘스트3의 카메라 권한으로 뭔가 뭔가 할 수 있는게 있지 않을까하며

고민을 하면서 AI모델들을 찾고있는데.

유니티 센티스는 아직 개발자들이나 회사나 아직 관심이 없다.

모델 나온지가 작년인데 지금와서 다운로드해서 사용한 사람이 하나도 없을정도.

샘플은 이미지용인데.

여러이미지를 시험적용해보다가 아예 렌더텍스쳐로 바꾸고 영상으로 체크를해보니

인식률이 너무 좋지않아 팔다리가 너무 자주 잘리고 순간이동이 너무 심하다.

장난감으로는 좋은데.

상용화레벨은 아직까지 아니다 싶다.

금요일까지 면접결과 안날아와서..

질문답변 틀리고 어버버 버렸던 면접복기에 이불좀 차고 시무룩좀 하고

다시 만들던 1인 게임개발 하고있었다.

메인게임 기능은 다 만들었고 상점구매기능까지 완성했다.

이 후 난이도 조절이랑 메타퀘스트 사양에서 잘 돌아가게 하기위한 게임디자인을 하고있었다.

늘 그렇듯 메타퀘스트.. 사양이 아무리 좋아도 패스쓰루 기능쓰면 배터리소모랑 프레임드랍이 심해서

오브젝트 많이 못올린다.

전에 회사를 다니던 때에도 1인게임 개발은 언제나 가슴속에 두고있었으니까.

사람은 희망에 죽고 사는 동물이니까 이렇게라도 해야 멘탈이 잡힌다.

토요일에 기술과제를 받았다.

금요일까지 일하시다가 쉬는날인데도 토요일에 보내주신거겠지.

고생이 많으시구나.

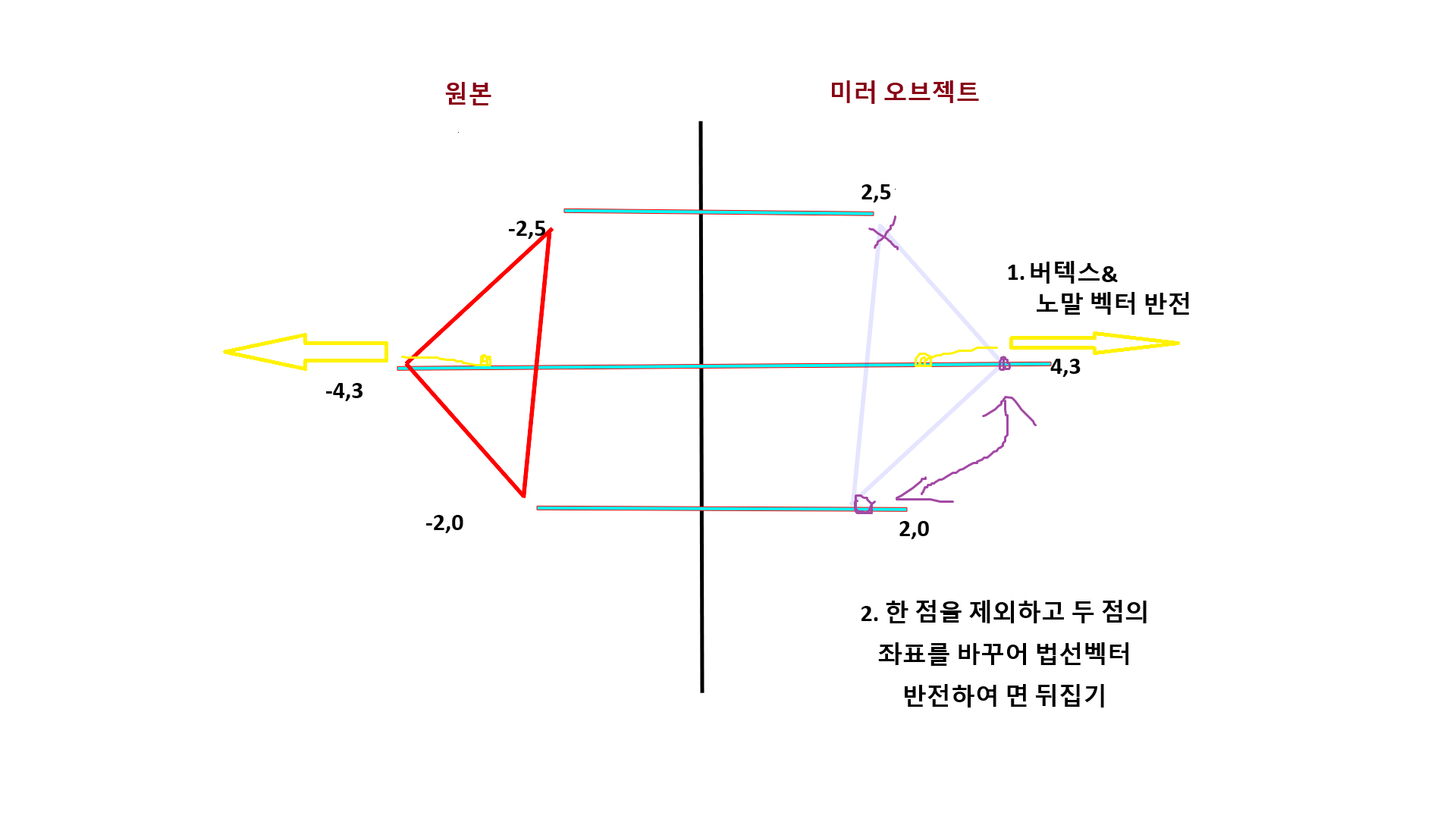

우리가 모델링툴에서 자주 사용하는 미러링기능을 만드는건데.

2017~18년 대학교때 그래픽스 과제할 때 했던걸 이제와서 다시 붙잡으려고하니까 기억도 안나서 사실 좀 겁난다.

수학 너무 어렵고 머리빠지고 실전투입이 바로 되는 천상계아니면 취업 안되는 현실을 아니까.

그래픽스 프로그래머보다 클라로 간건데 ㅠ

근데 어쩌겠는가.. 어떻게든 해야지.. 해봤는데 실력 안되는거니 겸허히 받아들이고.

곰곰히 생각해보다.

그냥 오브젝트 복사해서 만들고 스케일만 -1 곱해서 반전시키면

별도 무거운 연산없이 되는거 아닌가..? 라는 잔머리를 굴렸지만

문제내는 사람의 의도는 그게 아니니까 ㅜ

크게 정리.

각 축에따라서 버텍스에 해당하는 값에다가

2차원에서는 그 축을 제외한 좌표값에만 음수를 곱하면되지만

3차원에서는 폴리곤을 그린 후 법선벡터까지 올바르게 넣어야 겉면이 표시된다..

그림판과 마우스로 그리느라 힘들었다.

1.메쉬필터에서 메쉬정보(버텍스,노말) 가져오기.

2.각 축에 대해 버텍스에 음수 곱해서 좌표 반전.

3.버텍스 노말에도 동일하게 음수 곱하여 바라보는 방향 반전시키기.

4.음수를 곱하여 메쉬의 법선벡터가 반전됨으로 인해 메쉬의 표면이 안쪽을 향하게 되어 표면이 뒤집힘.

5.각 폴리곤 tris의 정점의 두번째,세번째의 위치를 스와핑해서 면을 뒤집어 표면을 뒤집기.

6. 5번의 과정을 반복하여 나온 결과물들을 생성한 미러 메쉬에 할당.

7.위치에 -1를 곱해서 좌표값 반전.

8.축에 해당하는 축에 -1 를 곱해서 회전값 반전. w축에도 하지않으면 반전안됨.

9.스케일 조정 ..etc

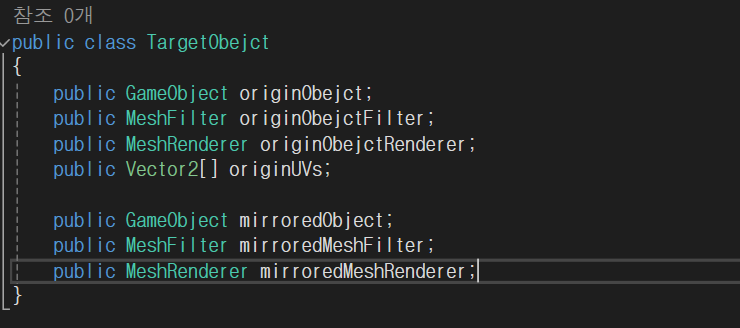

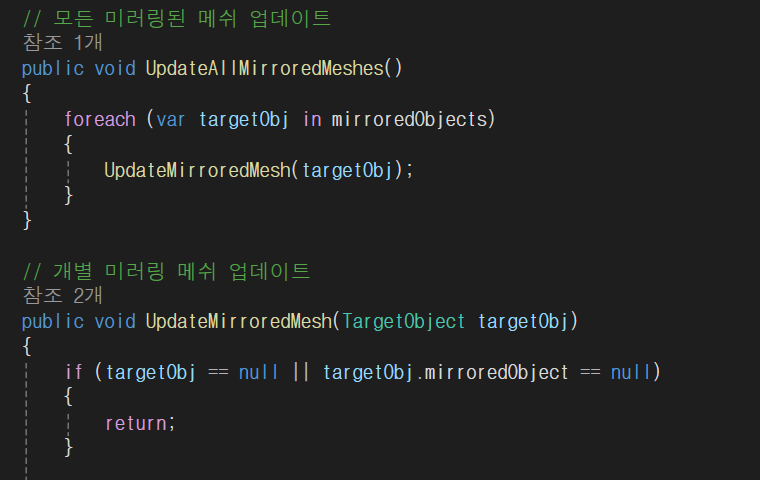

여러개의 오브젝트 미러링기능 확장하기.

원본,미러링 오브젝트의

메쉬필터와 렌더러를 어떻게 관리하는게 효율적일지 고민을 좀 오래했다.

1:1 매핑이 문제인데. 딕셔너리는 키값하나에 하나에 밸류밖에 안되니 결국 인덱스

기반으로 여러개 만들어서 여러번 돌려야하니

그냥 클래스로 묶어서 foreach 돌리기로 결정.

코드도 20줄 내외로 변경했고 너무 간편하게 구현했다

깃허브에 올려야지

| Text Mesh Pro 한글폰트 제작방법 (0) | 2023.01.02 |

|---|

텐센트 혼원3D 2.0 출시 - 고품질 3D 자산 생성 시스템 | ComfyUI Wiki

텐센트는 텍스트와 이미지를 기반으로 고해상도 3D 자산을 생성하는 두 단계 프로세스를 갖춘 혼원3D 2.0 시스템을 출시했습니다.

comfyui-wiki.com

모델러 없이 모델링 뽑기 스터디중 발견했던 방법을 행동에 옮겨보기로 했다.

빠르게 컴피UI(포터블) 최신버전 설치+ 그외 필요한 커스텀노드 쫙 깔아주고.

설치는 전부 깃헙에 써있는 인스톨방법을 PC 사양에 맞게 따르면된다.

https://github.com/comfyanonymous/ComfyUI?tab=readme-ov-file#installing

GitHub - comfyanonymous/ComfyUI: The most powerful and modular diffusion model GUI, api and backend with a graph/nodes interface

The most powerful and modular diffusion model GUI, api and backend with a graph/nodes interface. - comfyanonymous/ComfyUI

github.com

https://github.com/kijai/ComfyUI-Hunyuan3DWrapper

GitHub - kijai/ComfyUI-Hunyuan3DWrapper

Contribute to kijai/ComfyUI-Hunyuan3DWrapper development by creating an account on GitHub.

github.com

https://github.com/MrForExample/ComfyUI-3D-Pack

GitHub - MrForExample/ComfyUI-3D-Pack: An extensive node suite that enables ComfyUI to process 3D inputs (Mesh & UV Texture, etc

An extensive node suite that enables ComfyUI to process 3D inputs (Mesh & UV Texture, etc) using cutting edge algorithms (3DGS, NeRF, etc.) - MrForExample/ComfyUI-3D-Pack

github.com

https://github.com/ltdrdata/ComfyUI-Manager

GitHub - ltdrdata/ComfyUI-Manager: ComfyUI-Manager is an extension designed to enhance the usability of ComfyUI. It offers manag

ComfyUI-Manager is an extension designed to enhance the usability of ComfyUI. It offers management functions to install, remove, disable, and enable various custom nodes of ComfyUI. Furthermore, th...

github.com

혹시 몰라 전후측면이미지가 필요한것과 아닌 모델 두개 전부 다운받았다.

다 다운받았으면

공식 도큐를 참고해서 만들어보자.

https://docs.comfy.org/tutorials/3d/hunyuan3D-2

ComfyUI Hunyuan3D-2 Examples - ComfyUI

ComfyUI now natively supports Hunyuan3D-2mv, but does not yet support texture and material generation. Please make sure you have updated to the latest version of ComfyUI before starting. The workflow example PNG images in this tutorial contain workflow JSO

docs.comfy.org

툰쉐이더..목적으로 만들어진 모델이지만 귀여운 멍뭉이 실사 사진을 넣어본다.

??? 실사는 안되나보다..

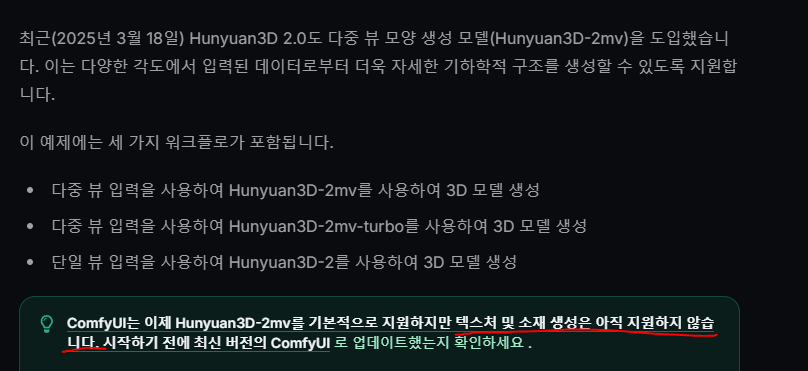

텍스쳐가 왜 안되지?했는데.

아직 안된다고한다..ㅜ

이래서 Wrapper를 쓰는구나 싶다.

cpu - 9700f

ram - ddr4 - 32g

gpu - rtx2070 super

환경에서 하나 만드는데 2분. 걸렸다

참고 튜토리얼이 아닌 과정 기록용이기 때문에

혹시 튜토리얼을 찾다가 유입하셨다면 아래 유튜브를 보고 따라해보시길 바랍니다!

이글을 작성한 때 버전보다 옛날버전 영상이라 뭔가 안된다면 직접 찾으셔야합니다.

https://www.youtube.com/watch?v=zqTTYYqHBhc&ab_channel=MDMZ

| 블렌더+ Claude MCP로 메쉬 최적화하기. (0) | 2025.04.07 |

|---|---|

| AI를 활용한 딸깍으로 슬라임 3D모델링 만들기. (0) | 2025.03.27 |

| 기술문서도 이제는 ai가 다 짜준다! (0) | 2025.03.17 |

게임에 사용할 슬라임 모델링을 찾는데 모델러 찾고.. 인건비도 비싸고 해서.. 잠깐 2시간 서칭해서 만들어본 과정과 후기.

1. 클로드에서 만들고싶은 슬라임을 묘사해서 프롬프트를 요청한다.

2. 그대로 생성형 AI 웹에 들고가서 생성버튼을 딸깍.

https://labs.google/fx/ko/tools/image-fx

3.대강 맘에 든다면 hyper3D에 들어가서 생성된 이미지를 드래그 앤 드롭하고 메쉬생성을 딸깍.

https://hyper3d.ai/rodin/1c3e7a53-8f7f-43af-ac6a-5f2b453ca18d

Hyper3D

hyper3d.ai

하면 이렇게 메쉬를 만들어준다.

다른 추가옵션중에 gameReady를 하고싶었는데 돈내야했다.

4. 마지막으로 텍스쳐를 만들어달라고 딸깍.

https://hyper3d.ai/imageto3d/b6a3ae67-fda7-48c2-837a-cd669cae92ec

Hyper3D

hyper3d.ai

그러면 메쉬와함께 택스쳐가 매핑된 3D 모델이 생성된다.

5. 스케치팹에 업로드 해보았다.

a Cute Slime - 3D model by gksthf2845 - Sketchfab

My Slime name is Muyaho

sketchfab.com

총평.

대단하다.

내가 모델러였으면 처음에 구,정육면체에서 시작했던 과정을 많이 생략할 것 같다.

다만 폴리곤 조절은 돈이 있어야하고

애니메이션은 따로 리깅을해야하니 요즘처럼 유저들의 눈이 높아진 시대에서

당장 인력없이 게임에 쓰기는 어려울 것 같다.

쿠키.

2018년도 대학생 때 3D MAX로 만들었던 미소녀가 있다.

저거 한 달동안 버텍스 깎고 리깅하고 그랬는데.

저 때 퀄리티랑 비교하면 이젠 그럴 필요가 없다는게 기분이 이상하다.

번외로 텐센트에서 3D모델을 생성하는 모델을 제작했는데 나중에 한번 사용해볼것.

https://comfyui-wiki.com/ko/news/2025-03-19-tencent-hunyuan3d-2-release

텐센트 혼원3D 2.0 출시 - 고품질 3D 자산 생성 시스템 | ComfyUI Wiki

텐센트는 텍스트와 이미지를 기반으로 고해상도 3D 자산을 생성하는 두 단계 프로세스를 갖춘 혼원3D 2.0 시스템을 출시했습니다.

comfyui-wiki.com

스테이블 디퓨전 https://comfyui-wiki.com/ko/news/2025-03-20-stdgen

StdGEN: 단일 이미지에서 의미적으로 분해된 3D 캐릭터 생성 | ComfyUI Wiki

칭화대학교와 텐센트 AI 연구소가 공동으로 StdGEN을 발표, 단일 이미지에서 신체, 의복, 머리카락 등 구성 요소가 분리된 고품질 의미 분해 3D 캐릭터를 생성하는 혁신적인 파이프라인 제공

comfyui-wiki.com

커서나 클로드로 블렌더MCP 연결해서 모델링하기.

아직은 간단한 오브젝트 배치수준이지만. 2년 안으로 스컬핑까지 가능하지 않게될까 싶다..

https://www.youtube.com/watch?v=RjOMs1AyW1w&ab_channel=%E5%BA%9F%E6%89%8D%E4%BF%B1%E4%B9%90%E9%83%A8Club

| 블렌더+ Claude MCP로 메쉬 최적화하기. (0) | 2025.04.07 |

|---|---|

| 3월에 나온 ComfyUI + hunyuan3D-2 모델 사용해서 뽑아보기 (1) | 2025.03.28 |

| 기술문서도 이제는 ai가 다 짜준다! (0) | 2025.03.17 |

v74가 되어서야 했네요.

개인정보다 뭐다 해서 영원히 안해줄줄 알았는데..

근데 분명히 사용자의 카메라를 녹화해서 서버에 저장하는 회사나 개발자.. 분명 한 명은 나올 것 같다고 생각했는데

그래서 그런지 해당기능을 포함한 어플리케이션은 메타스토어에 업로드하지 못하게 막아놨다.

심지어 유니티 센티스, OPEN AI와 api 연동도된다.

이제 진짜 컨텐츠 아이디어 싸움이다.

https://developers.meta.com/horizon/documentation/unity/unity-pca-documentation

Implementation using WebCamTexture

This section describes how to access the Passthrough Camera API using the Unity WebCamTexture and the complimentary helper classes that offer advanced data access like camera intrinsics / extrinsics.

developers.meta.com

https://github.com/oculus-samples/Unity-PassthroughCameraApiSamples

GitHub - oculus-samples/Unity-PassthroughCameraApiSamples: A Sample Project for Passthrough Camera API in Unity.

A Sample Project for Passthrough Camera API in Unity. - oculus-samples/Unity-PassthroughCameraApiSamples

github.com

https://github.com/xrdevrob/QuestCameraKit

GitHub - xrdevrob/QuestCameraKit: QuestVisionKit is a collection of template and reference projects demonstrating how to use Met

QuestVisionKit is a collection of template and reference projects demonstrating how to use Meta Quest’s new Passthrough Camera API for advanced AR/VR vision, tracking, and shader effects. - xrdevro...

github.com

| 미래의 자기 자신을 위해 매니저 클래스는 중복을 예방하자. (0) | 2025.03.23 |

|---|---|

| 이미지 추척방식의 핸드트래킹으로 액션게임 만들지 마세요. (0) | 2025.03.18 |